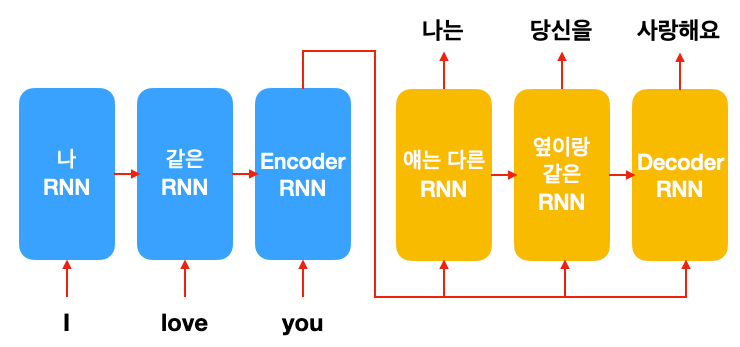

seq2seq 모델 은 encoder decoder model 과 RNN을 합친 모델이다.

합치면 아래와 같은 동작 순서를 지닌다.

조건부 확률로서 앞 단어 몇개가 주어졌을 때, 다음 나올 단어는 무엇인가를 파악하기위해

각 상자마다 hidden state를 결과로 뱉는데 이를 RNN에서 계속 확인하며 번역에 들어간다.

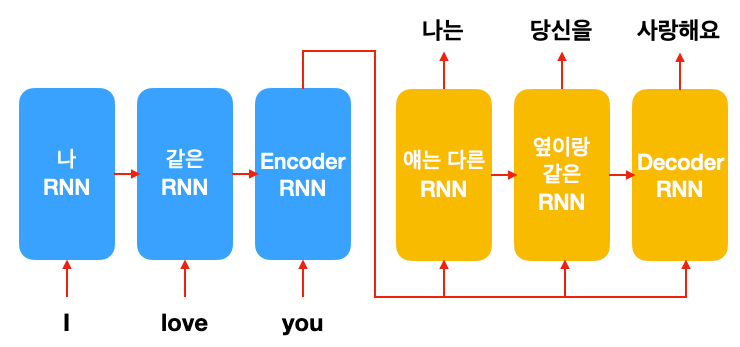

seq2seq 모델 은 encoder decoder model 과 RNN을 합친 모델이다.

합치면 아래와 같은 동작 순서를 지닌다.

조건부 확률로서 앞 단어 몇개가 주어졌을 때, 다음 나올 단어는 무엇인가를 파악하기위해

각 상자마다 hidden state를 결과로 뱉는데 이를 RNN에서 계속 확인하며 번역에 들어간다.

댓글